Prédiction de la réussite professionnelle (avec diagramme et statistiques)

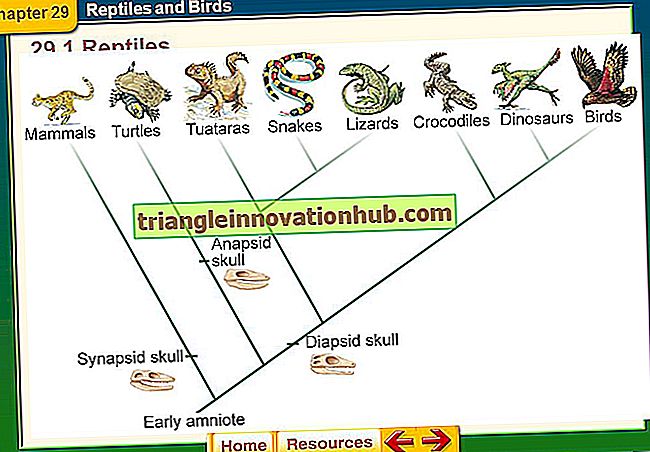

La prédiction de la réussite professionnelle implique de déterminer dans quelle mesure le prédicteur est lié au critère. Par exemple, supposons que l’on souhaite mettre en place un programme de sélection pour embaucher de nouveaux commis aux dossiers. Supposons en outre qu’il ait été décidé d’utiliser un test papier-crayon de l’aptitude des employés de bureau comme facteur prédictif de l’efficacité des commis aux dossiers, et que l’efficacité devait être déterminée par les notations des superviseurs. Le tableau 2.3 présente quelques données hypothétiques pour cette situation supposée, donnant les scores de douze commis au fichier à la fois sur le test des écritures et sur la mesure du critère d'efficacité. La figure 2.5 présente un graphique des données du tableau 2.3.

Notez qu'il semble y avoir une tendance systématique. En règle générale, plus une personne obtient une note élevée au test d'écriture, plus elle obtient une note supérieure à la mesure de ses compétences professionnelles. Nous pouvons donc en déduire qu'il existe une relation définie entre la performance du test (le prédicteur) et la compétence professionnelle (le critère). Nous pouvons également en déduire que, si nous sélectionnons les personnes qui obtiennent de meilleurs résultats au test, nous serons plus enclins à embaucher des personnes qui seront plus compétentes que si nous embauchions des personnes indépendamment du score au test.

Établissement du degré de relation:

Le degré de relation entre deux variables quelconques peut être défini comme la mesure dans laquelle ces deux variables varient ensemble de manière systématique. Le terme plus technique utilisé est le degré de covariance existant entre les variables. Une mesure formelle du degré de covariance entre deux ensembles de scores quelconques est fournie par une statistique appelée coefficient de corrélation. Lorsque deux ensembles de scores sont fortement liés, nous disons qu'ils sont fortement corrélés. La mesure de corrélation la plus courante est le coefficient de corrélation Moment du produit Pearson, désigné par le symbole r.

En tant que mesure de la relation, r varie entre + 1, 00 et -1, 00. Lorsque r est égal à + 1, 00, les deux ensembles de scores sont positivement et parfaitement liés. Lorsque r est égal à -1, 00, les deux ensembles de scores sont négativement et parfaitement liés l'un à l'autre. Lorsque r = 0, 00, les deux ensembles de scores n'ont aucun lien l'un avec l'autre. La figure 2.6 montre des graphiques de différentes magnitudes de r.

Dans la prévision de la réussite professionnelle, le signe du coefficient de corrélation n’est pas important, mais son ampleur l’est. Plus la taille absolue de r est grande, meilleure est la prédiction des scores des critères sur la base des informations obtenues à partir du prédicteur.

Pour comprendre la logique de la corrélation, il peut être utile de considérer une représentation imagée de la covariance et sa relation avec r. Toute série de scores présentera une certaine variation - en fait, comme nous l’avons déjà vu, les scores des personnes présentant de nombreux traits suivent une distribution normale avec un petit nombre de scores très élevés, un petit nombre de scores très faibles et la plupart des des scores survenant au milieu de la distribution.

Supposons que nous représentions cette variance dans un ensemble de scores de critères, comme indiqué ci-dessus, où la surface totale est définie à 1, 00. Nous pouvons le faire car il est possible de transformer n’importe quel jeu de scores bruts de sorte que leur variance soit égale à 1, 00 en utilisant ce que l’on appelle la transformation de score az.

De même, supposons que nous ayons un ensemble de scores de prédicteurs qui varient également et sont distribués normalement, et là encore, la surface est définie comme étant égale à la quantité 1, 00. Nous pouvons maintenant représenter r géométriquement comme étant lié au degré de chevauchement (covariance) des deux ensembles de partitions.

Une définition plus précise de r en tant que statistique est le rapport entre le montant de la covariance entre deux variables et la racine carrée du produit des variances respectives (parfois appelée moyenne géométrique), qui peut être schématisé comme indiqué ci-dessous:

En revenant aux données du tableau 2.3, il est possible de calculer la corrélation entre ces deux ensembles de scores en utilisant la formule

Le lecteur est averti que r ne peut pas être interprété comme un pourcentage. Si r = 0, 50, cela ne signifie pas que 50% de la variance du critère est prévisible à partir de la variable de sélection. Le carré de r, cependant, peut être ainsi interprété. Une corrélation de 0, 50, lorsqu'elle est au carré, donne r 2 = 0, 25, ce qui peut être interprété comme le pourcentage de variance du critère prédit par la variable de sélection.

La statistique r 2 est parfois appelée coefficient de détermination car elle représente l'ampleur de la variance dans une variable qui peut être «déterminée» en connaissant les scores d'une seconde variable. La figure 2.7 montre la relation entre r (mesure de la relation) et r 2 . Notons qu'il est possible d'obtenir des r de taille assez importante et de ne représenter qu'une faible proportion de la variance du critère.

Régression:

Comme nous l'avons vu, le coefficient de corrélation r mesure le degré de relation entre deux variables. En soi, cependant, cela ne nous fournit pas de procédure permettant de prédire un ensemble de scores d'un autre. La technique par laquelle cela est fait s'appelle l'analyse de régression. La régression peut être considérée comme étant liée à la corrélation comme suit: La corrélation mesure l’ampleur ou le degré de relation entre deux variables, tandis que la régression décrit le type de relation entre variables qui peut à son tour être utilisée pour faire des prédictions.

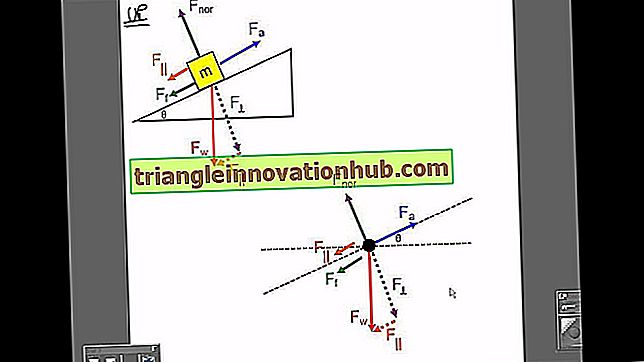

Pour illustrer la régression, considérons les scores tracés à la figure 2.8a. De toute évidence, il existe une relation positive substantielle entre le prédicteur et le critère dans ce cas. Malheureusement, la figure 2.8a ne nous fournit aucune information sur la relation exacte autre que le fait qu’elle est linéaire (r ne mesure toujours que le degré de relation linéaire, par opposition à la relation curvilinéaire, entre deux variables). Si nous voulons prédire les scores des critères à partir d'un dispositif de sélection, il est clair que nous devons décrire plus précisément la relation observée entre le prédicteur et le critère.

Ceci est accompli en trouvant la ligne ou la fonction qui décrit le mieux les points de données. Cela s'appelle l'ajustement d'une «ligne de meilleur ajustement» aux données. Puisque nous supposons que la relation est linéaire (nous avons utilisé r pour mesurer sa magnitude), le type de ligne que nous utilisons doit être droit, c'est-à-dire qu'aucune ligne courbe n'est autorisée. Cette ligne droite la mieux adaptée est appelée ligne de régression et peut être utilisée pour prédire le critère à partir du prédicteur.

La figure 2.8b montre deux lignes de meilleur ajustement différentes qui pourraient être obtenues si nous demandions à deux personnes différentes d'examiner les données, puis de tracer une ligne entre les points qui, à leur avis, semblent mieux décrire la tendance ou le lien entre les variables. Bien que la tendance générale soit similaire, nous constatons que les deux personnes ne sont pas tout à fait d’accord avec leur estimation de la relation.

Ce désaccord entraînerait à son tour un désaccord sur le score de critère prévu en fonction de la droite de régression estimée utilisée. Si un candidat à un poste obtient une note x sur l'instrument de sélection, nous prédirions une note de critère de y 1 pour ce candidat si nous utilisions la droite de régression de la première personne. si nous utilisions la droite de régression de la deuxième personne, nous prédirions y 2 comme score de critère le plus probable. Quelle régression est correcte?

Il est difficile de répondre à cette question à moins de disposer d’une base suffisante pour décider de ce qu’est réellement un «meilleur ajustement». Heureusement, les statisticiens ont généralement convenu que la meilleure courbe est celle qui passe par les points de manière à minimiser la somme des distances au carré (dans la dimension y) des points à partir de la ligne, comme indiqué à la figure 2.9.

Une ligne qui minimise Σd 2 est appelée ligne de régression des «moindres carrés». Ces lignes de régression sont mathématiquement directement liées à r. L'utilisation de la méthode des moindres carrés pour obtenir notre ligne de prédiction assurera que différentes personnes se retrouveront avec la même ligne (en supposant qu'elles ne commettent aucune erreur de calcul). De même, le score de critère prévu pour une valeur x particulière ne variera pas en fonction de la personne qui correspond à la droite de prédiction (voir la figure 2.8c).

À ce stade, le lecteur peut demander: «Pourquoi devons-nous prédire les scores des critères alors que nous les avons déjà?» La réponse est assez simple. La mesure initiale de l'étendue de la relation entre le prédicteur et le critère nécessite évidemment les deux ensembles de scores, sinon la relation n'aurait pas pu être établie. Si le dispositif de sélection s'avère utile, il peut alors être utilisé avec tous les nouveaux candidats pour lesquels il peut exister un score prédictif mais pour lesquels un score critère n'existe pas.

Notre objectif est de prédire les critères de performance des futurs candidats. Si un nouveau candidat obtient un score élevé sur un test dont la relation positive avec le critère est élevée, nous devrions alors nous attendre à ce qu'il ait une forte probabilité de succès.